🦞 OpenClaw 2026.4.20-beta.1 — รีลีสที่ทำให้ Agent “นิ่งขึ้น”…

🦞 OpenClaw 2026.4.20-beta.1 — รีลีสที่ทำให้ Agent “นิ่งขึ้น” ทั้งระบบ ไม่ได้แค่เพิ่มฟีเจอร์ใหม่

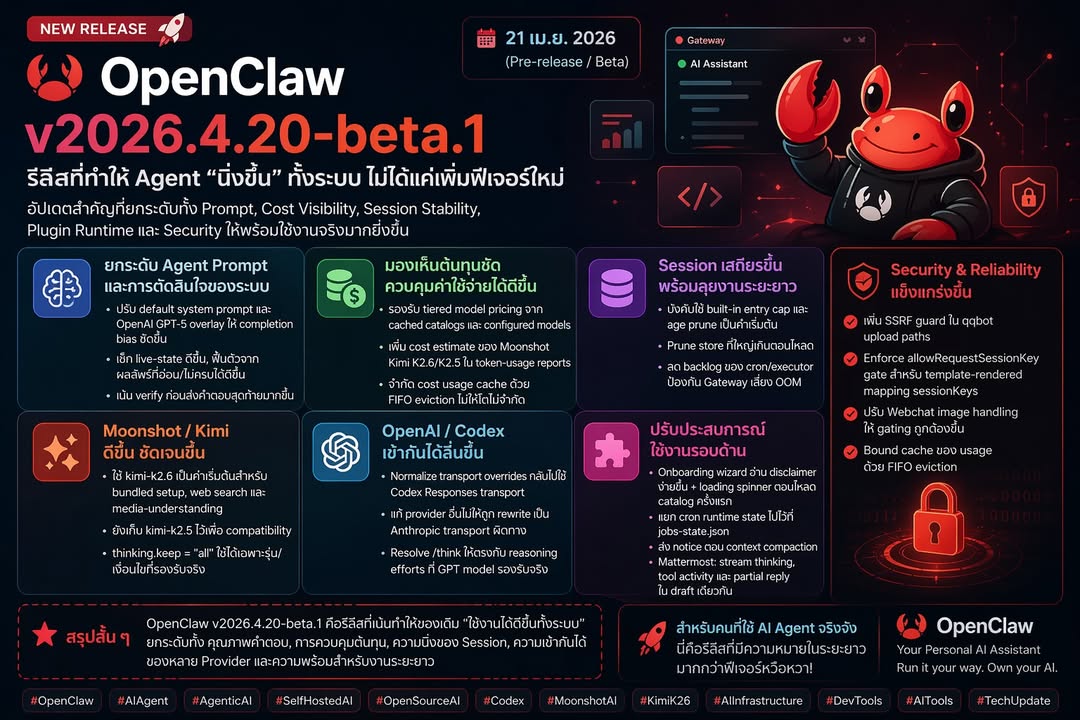

รีลีสล่าสุดของ OpenClaw รอบนี้ เป็น pre-release / beta ที่ปล่อยเมื่อวันที่ 21 เมษายน 2026 และถ้ามองเผิน ๆ หลายคนอาจรู้สึกว่า changelog รอบนี้เป็นงานปรับภายในเสียมากกว่า แต่พออ่านละเอียดจะเห็นว่า release นี้แตะหลายจุดที่สำคัญมากสำหรับคนที่ใช้ AI agent แบบจริงจัง ทั้ง onboarding, prompt quality, session stability, model cost visibility, plugin runtime และ security hardening ไปพร้อมกัน (GitHub)

สำหรับคนที่ยังไม่คุ้น OpenClaw โปรเจกต์นี้นิยามตัวเองชัดว่าเป็น Personal AI Assistant ที่รันบนอุปกรณ์ของเราเอง ตอบกลับผ่านช่องทางที่เราใช้อยู่แล้ว และมี Gateway เป็น control plane กลางของระบบ นั่นทำให้ทุกการเปลี่ยนแปลงเรื่อง session, tools, channels และ execution model ของมัน มีความหมายมากกว่าแค่การอัปเดตหน้าตา แต่กระทบประสบการณ์ใช้งานจริงโดยตรง ⚙️ (GitHub)

รอบนี้สิ่งที่ผมมองว่าเด่นมาก คือการอัปเกรดฝั่ง Agent Prompt และการตัดสินใจของระบบ OpenClaw ระบุชัดว่ามีการปรับ default system prompt และ OpenAI GPT-5 overlay ให้มี completion bias ที่ชัดขึ้น, เช็ก live-state ดีขึ้น, ฟื้นตัวจาก weak results ได้ดีขึ้น และย้ำการ verify ก่อนตอบสุดท้ายมากขึ้น พูดง่าย ๆ คือไม่ใช่แค่ “ให้ agent ตอบได้” แต่พยายามทำให้ “ตอบได้ครบขึ้น ตรงขึ้น และไว้ใจได้มากขึ้น” 🔍 (GitHub)

อีกเรื่องที่สำคัญมากคือ ต้นทุนและการมองเห็น usage ของโมเดล เวอร์ชันนี้เพิ่มการรองรับ tiered model pricing จาก cached catalogs และ configured models พร้อมใส่ cost estimate ของ Moonshot Kimi K2.6/K2.5 ลงใน token-usage reports ด้วย จุดนี้อาจไม่ใช่ของที่คนเห็นแล้วว้าวทันที แต่สำหรับคนที่ใช้ agent ต่อเนื่องจริง มันสำคัญมาก เพราะคำถามในโลกจริงไม่ใช่แค่ “แรงไหม” แต่ต้องถามด้วยว่า “แพงแค่ไหน”, “คุมต้นทุนได้ไหม”, และ “ดู usage ได้ตรงหรือเปล่า” 💰 (GitHub)

ฝั่ง Session Stability และ Maintenance ก็ถือว่าเป็นแกนสำคัญของ release นี้เหมือนกัน OpenClaw บังคับใช้ built-in entry cap และ age prune เป็นค่าเริ่มต้น พร้อม prune store ที่ใหญ่เกินตอนโหลด เพื่อกัน backlog จาก cron/executor สะสมจน gateway เสี่ยง OOM ก่อนถึงรอบ write path นี่เป็นงานหลังบ้านที่คนทั่วไปอาจไม่พูดถึงเยอะ แต่สำหรับระบบ agent ที่ต้องวิ่งยาว ๆ เรื่องนี้คือของจริง เพราะมันแปลว่า “ระบบพร้อมอยู่กับงานระยะยาวมากขึ้น” 🧠 (GitHub)

อีกจุดที่น่าสนใจคือฝั่ง Moonshot / Kimi

release นี้ขยับ bundled Moonshot setup, web search และ media-understanding ให้ใช้ kimi-k2.6 เป็นค่าเริ่มต้น ขณะเดียวกันก็ยังคง kimi-k2.5 ไว้เพื่อ compatibility และยังเปิดให้ thinking.keep = "all" ใช้กับ moonshot/kimi-k2.6 ได้ แต่จะ strip ออกสำหรับรุ่นอื่นหรือ request ที่ pinned tool_choice ทำให้ thinking ใช้ไม่ได้

นี่สะท้อนว่าทีมไม่ได้แค่เพิ่มโมเดลใหม่ แต่พยายาม “จัดระเบียบพฤติกรรมของโมเดล” ให้ predictable มากขึ้นด้วย 🤖 (GitHub)

ฝั่ง OpenAI / Codex ก็มี fix ที่สำคัญพอสมควร

รอบนี้มีการ normalize legacy openai-completions transport overrides บน default OpenAI/Codex และ GitHub Copilot-compatible hosts กลับไปใช้ native Codex Responses transport, แก้ไม่ให้ provider ที่ไม่ใช่ Anthropic ถูก rewrite transport ผิด, และ resolve ระดับ /think ให้ตรงกับ reasoning efforts ที่ GPT model รองรับจริง

ผลคือคนที่ใช้หลาย provider ร่วมกัน โดยเฉพาะสาย OpenAI/Codex/GitHub Copilot จะได้พฤติกรรมที่สม่ำเสมอขึ้นกว่าเดิม 🔧 (GitHub)

นอกจากนั้นยังมีของยิบย่อยที่จริง ๆ สำคัญมาก เช่น

✨ ปรับ onboarding wizard ให้อ่าน security disclaimer ง่ายขึ้น

✨ เพิ่ม loading spinner ตอน model catalog โหลดครั้งแรก

✨ แยก runtime execution state ของ cron ไปไว้ใน jobs-state.json เพื่อให้ jobs.json คงเสถียรสำหรับไฟล์งานที่ track ด้วย Git

✨ ส่ง notice ตอนเริ่มและจบ context compaction

✨ ปรับ Mattermost ให้ stream thinking, tool activity และ partial reply ใน draft เดียวกัน

✨ ปรับ plugin/task runtime ให้ detached executors จัด lifecycle และ cancellation ได้ชัดขึ้น

ทั้งหมดนี้รวมกันทำให้รู้เลยว่าทีมกำลังเก็บรายละเอียดฝั่ง operator experience อย่างจริงจัง 📌 (GitHub)

ในมุม security และ reliability ก็มีของสำคัญเหมือนกัน

เช่นการเพิ่ม SSRF guard ใน qqbot upload paths, การ enforce allowRequestSessionKey gate สำหรับ template-rendered mapping sessionKeys, การปรับ Webchat image handling ให้ gating ถูกต้องขึ้น และการจำกัด cost usage cache ด้วย FIFO eviction ไม่ให้โตไม่จำกัด

ของพวกนี้อาจไม่ได้เป็นหัวข้อที่คนหยิบไปคุยก่อน แต่ในระบบที่เริ่มมี channel, tools, uploads และ long-running sessions เยอะขึ้น มันคือสิ่งที่ช่วยให้ของเดิม “พร้อมใช้จริง” มากขึ้นชัดเจน 🛡️ (GitHub)

ถ้าสรุปแบบตรงไปตรงมา OpenClaw 2026.4.20-beta.1 ไม่ใช่ release สายโชว์ของ แต่มันเป็น release สาย “ทำให้ของที่มี ใช้งานได้ดีขึ้นทั้งระบบ” มากกว่า มันอาจไม่ได้ทำให้คนว้าวใน 10 วินาทีแรก แต่สำหรับคนที่ใช้ AI agent จริง ๆ จะเห็นทันทีว่า release นี้ช่วยยกระดับทั้ง คุณภาพคำตอบ, การควบคุมต้นทุน, ความนิ่งของ session, ความเข้ากันได้ของหลาย provider และความพร้อมของระบบสำหรับงานระยะยาว 🚀 (GitHub)

ใครที่ตามสาย Agent, Self-Hosted AI, Codex, Kimi หรือ automation workflow อยู่ ผมมองว่า release นี้น่าจับตา เพราะมันสะท้อนชัดว่า OpenClaw ไม่ได้โตแค่ในมุม “ฟีเจอร์” แต่กำลังโตในมุม “ระบบ” ด้วย และในระยะยาว release แบบนี้แหละ ที่มักสำคัญกว่าฟีเจอร์หวือหวาเสียอีก 👀 (GitHub)

#OpenClaw #AIAgent #AgenticAI #SelfHostedAI #OpenSourceAI #Codex #GPT5 #MoonshotAI #KimiK26 #AIInfrastructure #DevTools #Automation #LLM #AITools #TechUpdate #สายเทค #ข่าวเทค #AIไทย #แฮชแท็กเทค

📖 อ่านบทความเต็มบน Facebook | 🔔 ติดตาม SynapTech

รับข่าว AI และบทความใหม่ก่อนผู้อื่น ส่งตรงถึง inbox

ขอบคุณ! รอรับข่าวจากเราได้เลย 📬

บทความแนะนำ

ถ้าชอบเนื้อหาแบบนี้

กดติดตาม SynapTech บน Facebook